| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 |

- spring

- post

- Bootstrap

- chartjs

- ES6

- AWS

- ssh

- MySQL Error

- html

- git

- 예매로직

- topologySpreadConstraints

- jsp

- mysql

- spread operator

- AWS Route53

- mongodb

- json

- ajax

- 인생이재밌다

- AWS RDS

- javascript

- node.js

- terminationGracePeriodSeconds

- 영화예매

- Kubernetes

- sessionStorage

- Java

- zombie-hit apartment

- Get

- Today

- Total

jongviet

March 3, 2024 - 오토스케일링으로 매번 흐트러지는 노드 별 파드 수, 균형을 어떻게 맞출 수 있을까? 본문

March 3, 2024 - 오토스케일링으로 매번 흐트러지는 노드 별 파드 수, 균형을 어떻게 맞출 수 있을까?

jongviet 2024. 3. 3. 15:46*3월3일

- 디플로이먼트 단위로 yaml을 제작하며, CPU 사용률 타겟을 설정 할 수 있다.

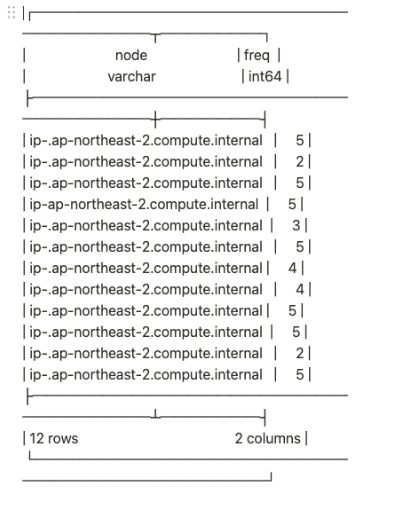

따라서 아래 표와 같이 어떤 노드는 특정 디플로이먼트의 파드 5개를 가지고, 또 다른 노드를 2개 밖에 가지지 못하는 상황이 생긴다. 과한 트래픽을 발생시키는 주요 디플로이먼트라고 가정했을 때 특정 노드에 트래픽이 몰려 CPU와 메모리 사용률을 과하게 유발하고 이는 해당 노드로 들어오는 요청에 매우 늦은 응답을 제공 할 수 밖에 없게 만든다.

서칭을 통해 Descheduler를 helm 적용 했음에도 이러한 현상은 파드 배정 불균형 현상은 크게 개선되지 않았다. 그러던 와중 이러한 고민을 해결 해줄 수 있는 topologySpreadConstraints라는 설정값을 외부 조언을 통해 알게 되었다. 이는 파드의 균등한 분포를 위한 설정인데, 주요한 설정값은 아래와 같다.

maxSkew // 적용된 숫자만큼의 차이만 동일 디플로이먼트가 각 노드에 배정 될 때 허용. 해당 값이 1이면 3,3,3,3,4,4 정도와 같은 노드 별 파드 배정을 가지게 됨.

topologyKey // 어느 단위로 차이를 따질 지 정하는 필드. kubernetes.io/hostname는 노드 기준으로 차이를 따짐. 그 외 다양한 기준이 있음.

whenUnsatisfiable // 만약 maxSkew가 적용 될 수 없는 상황이라면 어떻게 처리할지에 대한 설정값. DoNotSchedule은 maxSkew 값이 만족되지 못하는 상황일 때 스케쥴러에 신규 파드를 배정 조차 하지 않도록 하는 것이고 ScheduleAnyway는 최대한 적합한 곳에 배정하는 것이다.

설정값을 적용하면 아래와 같이 완벽한 수준의 노드 별 파드 배치를 가지게된다. 물론 DoNotSchedule이라는 설정값으로 인해 노드가 새로 뜨고 죽을 때 일부 파드가 pending 상태로 잠시 동안 남아 있게 되지만 오랜 시간이 소요 되지 않는 것으로 확인했다.

주요 디플로이먼트에 해당 설정을 적용한 이후, 노드 별 CPU 사용률이 꽤 균등하게 배정되게 되었고 전반적으로 균형있는 자원 사용이 이루어질 수 있었다.

'kubernetes' 카테고리의 다른 글

| Feb 29, 2024 - 쿠버네티스 내 배치 서버 파드, 오토스케일링으로 인해 갑자기 죽을 때 하던일은 마저하고 떠나보낼 수는 없을까..? (0) | 2024.02.29 |

|---|---|

| Oct 10, 2022 - Kubernetes 개념 (0) | 2022.10.10 |